本記事を10秒でまとめると

Googleがリアルタイム対話型検索「Search Live」を日本でも提供開始。同時に音声モデル「Gemini 3.1 Flash Live」も発表し、より自然な会話が可能になり現実世界を理解する検索体験を実現。本記事ではGoogleは「検索」「AIモード」「Gemini」「Search Live」の各役割も詳細に説明。

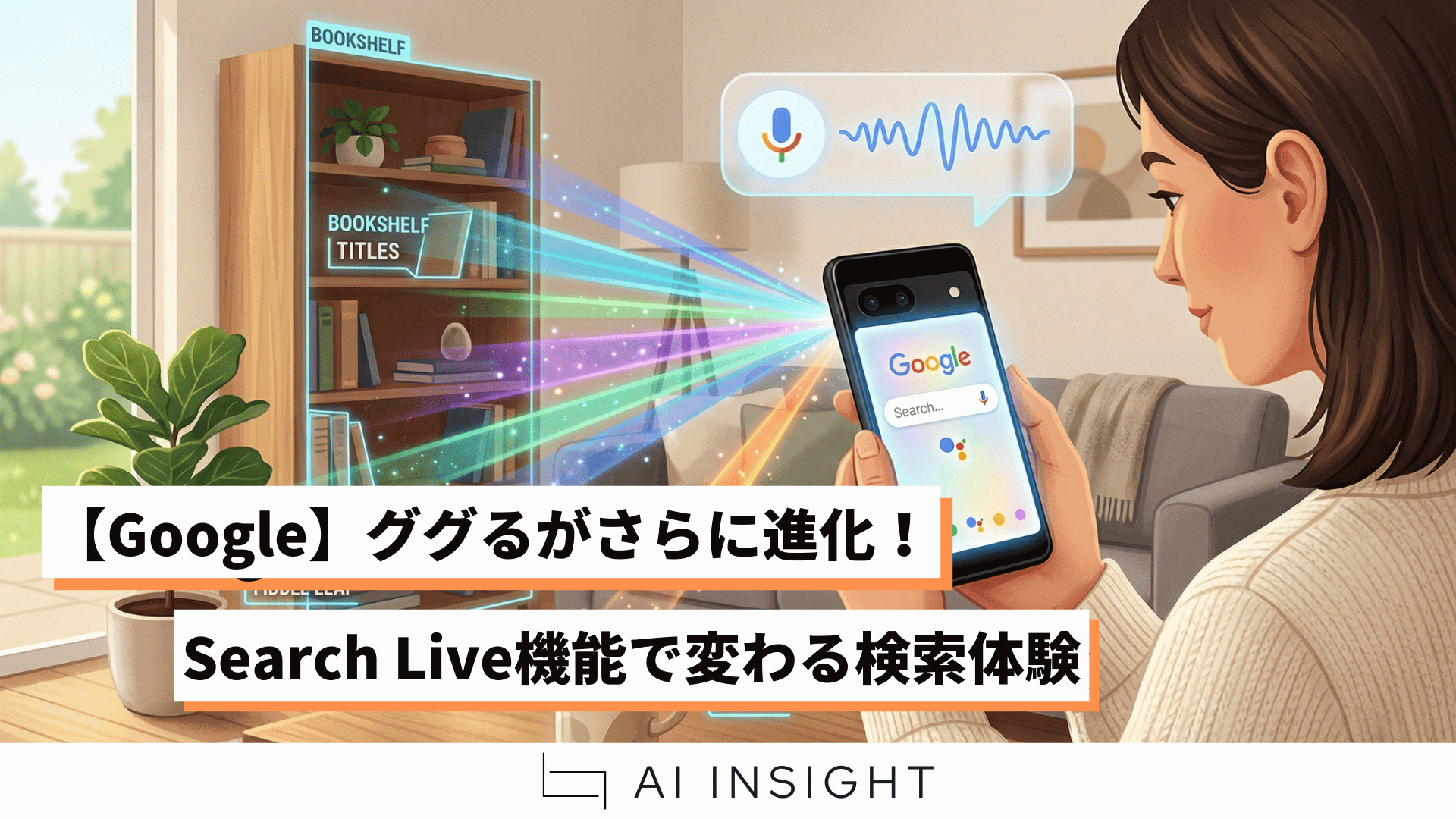

Search Liveとは

Googleはリアルタイム対話型検索機能「Search Live(検索Live)」を、日本を含むすべての言語と地域で提供すると発表しました。

Search Liveは、スマートフォンの「Google」アプリから利用できる機能で、アプリ内の「ライブ」アイコンをタップすることで起動します。ユーザーは音声やカメラを使いながら、Geminiとリアルタイムで会話しながら検索を行うことができます。

従来のGoogle検索は、キーワードを入力して結果を一覧表示する仕組みでした。一方Search Liveでは、ユーザーが音声で質問を行うと、Geminiが会話形式で回答を返します。また、スマートフォンのカメラを使って目の前の物体を映すことで、その状況を踏まえた回答を得ることも可能です。

この機能は、文字入力を行うことが難しい場面や、リアルタイムのサポートが必要な場面での利用を想定しています。

Search Liveでできること

例えば、家具の組み立て方法が分からない場合、スマートフォンのカメラで棚や部品を映しながら「これどうやって組み立てるの?」と音声で質問すると、Geminiが状況を理解した上で手順を説明し、関連する情報やリンクを提示します。

また、機械のトラブルや製品の使い方など、実物を見ながら質問することで、従来の検索よりも具体的なサポートを得ることができます。

Search LiveはGoogle Lensとも連携しており、カメラで映した映像をもとにAIが状況を理解しながら会話を続けることができます。これにより、現実世界を対象とした検索体験が大きく拡張されています。

裏側の技術「Gemini 3.1 Flash Live」

今回のSearch Liveの実現を支えているのが、Googleが同時に発表した音声モデル「Gemini 3.1 Flash Live」です。

Gemini 3.1 Flash Liveは、Gemini 3 Proをベースとしたネイティブマルチモーダル推論モデルで、音声、画像、動画、テキストといった複数の情報を同時に処理することができます。最大128Kトークンのコンテキストウィンドウを備えており、長い会話の文脈を維持しながら対話を続けることが可能です。

従来モデル「2.5 Flash Native Audio」と比較して、処理精度の向上と大幅な遅延の低減が実現されています。これにより、より自然で滑らかなリアルタイム対話が可能になりました。

特に、声の高さや話すペースといった音響的なニュアンスを理解する能力が向上しており、ユーザーの不満や混乱といった感情表現に合わせて応答を調整できるようになりました。

また、会話の文脈をこれまでの2倍の長さで保持できるようになったことで、長時間のブレインストーミングや複雑なタスク処理にも対応できます。

GoogleのAI系ツールはどう使い分けるべきか

現在Googleには、複数のAI機能が存在しており、それぞれ役割が異なります。

まず我々にも馴染みが深い従来のGoogle検索は、ニュースやWebサイトなどの情報を素早く探す用途に適しています。

一方で「AIモード(AI Mode)」は、複数の情報をまとめて調べたり、比較したりするような調査型の検索に向いています。

<記事挿入>

Google検索AIモードはいつから?Geminiとの違いも解説

「Gemini」は文章作成やアイデア出しなど、AIアシスタントとしての用途に適しています。ChatGPTに近い役割を担うサービスともいえるでしょう。

そして今回登場したSearch Liveは、音声とカメラを使って現実世界の状況を理解しながら問題を解決する用途に向いています。

つまり、GoogleのAIは現状一つのサービスに集約されているわけではなく、それぞれの用途に応じて役割が分かれている形になっています。

ですが、この役割が分かれている状態は一時的かもしれません。近年Googleは検索機能のAI化を急速に進めています。

実際に、検索結果に対してGeminiが要約を表示する「AI Overview」、対話型検索を可能にする「AI Mode」、そして今回の「Search Live」といった機能が次々と追加されています。

これらの流れを見ると、Google検索は従来のキーワード検索から、Geminiと会話しながら問題を解決する検索体験へと進化していると考えられます。

特にSearch Liveは、音声やカメラを通じて現実世界とGeminiを直接つなぐ機能であり、スマートフォンがAIアシスタントとして機能する未来を示すものともいえそうです。

まとめ

AIモードの利用はまだまだ限定的である一方、このSearch Liveは我々の検索という行動を大きく変えてくる可能性を秘めています。

従来のGoogle検索もAIモードもGeminiも画像検索や音声入力はあれどベースはテキストを入力してテキストや画像が帰って来るという我々の従来の体験の延長戦上でした。

今回の発表は、単なる機能追加ではなくリアルタイムで対話しながら目の前の疑問が解決するという明らかな新体験です。

今後Googleがどの段階で各検索手法を統合していくかは不明ですが、将来「ググる」という言葉が「スマホを向けて話しかける動作」の呼称になる未来もそう遠くはないかもしれません。

writer:佐伯 美月(AIインサイト編集部)