本記事を10秒でまとめると

OpenAI、Google、Anthropicの3社が、中国AI企業によるモデル模倣への対抗として連携を開始した。問題視されているのは「蒸留(distillation)」と呼ばれる手法で、他社AIの出力を大量に取得して新しいモデルの学習に利用する方法である。米AI企業は情報共有などを通じて不正アクセスや能力抽出の検知を強化する方針だ。

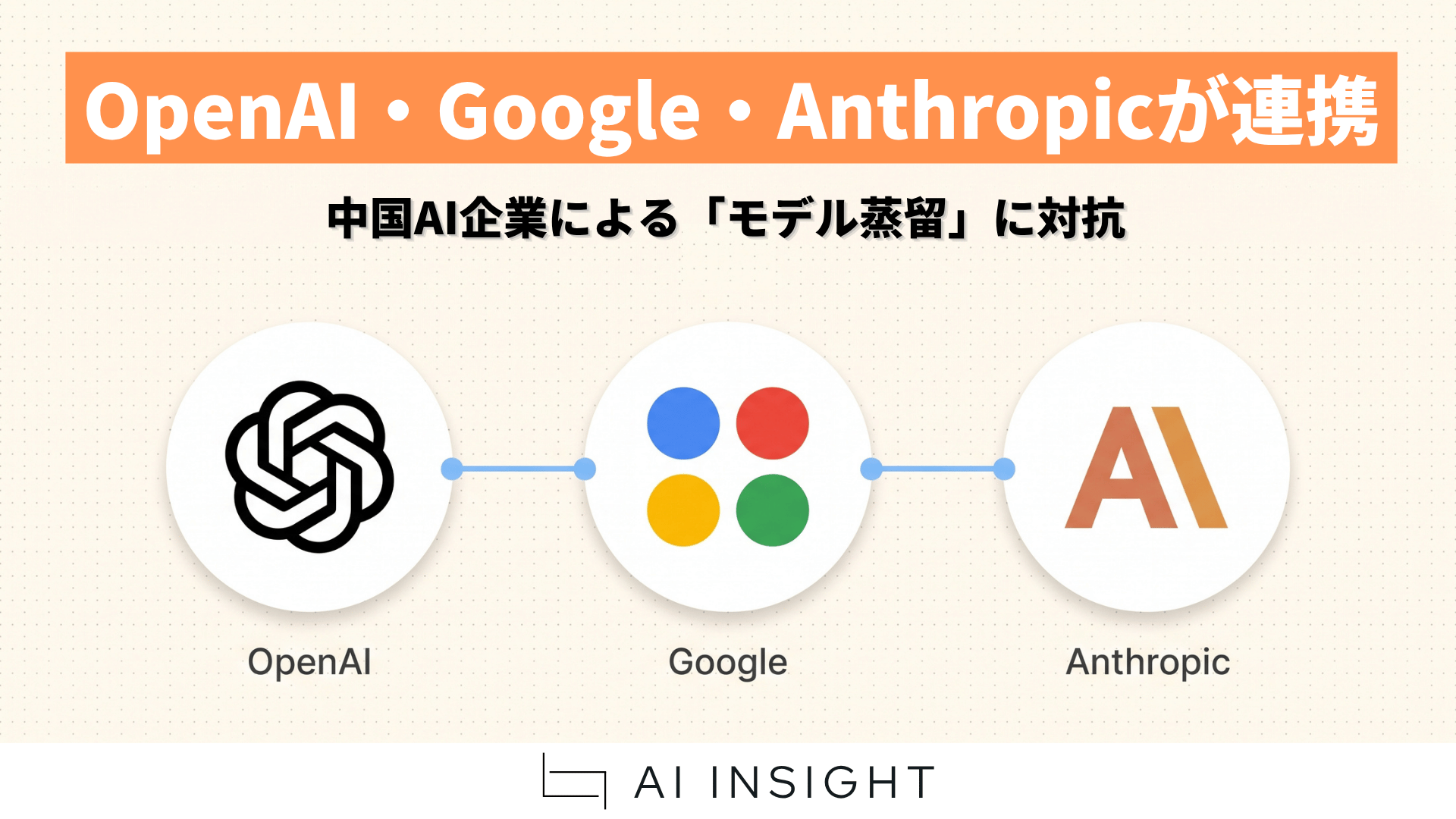

OpenAI・Google・Anthropicが異例の連携

米AI企業で生成AI市場を牽引しているファンダメンタルモデルを有する

- OpenAI

- Anthropic

の3社が、中国AI企業によるAIモデルの模倣を防ぐために協力関係を築いていることがBloombergの報道で明らかになりました。

通常、これらの企業は大規模言語モデル(LLM)の開発競争において互いに激しい競争関係にあります。しかし近年、中国企業が米国のAIモデルから出力を抽出して独自モデルを訓練する試みが増えているとされ、企業間の連携が始まったととされています。

この取り組みは、AI企業による安全性団体「Frontier Model Forum」などを通じて行われていると報じられています。

問題となっている「蒸留(distillation)」とは

今回の問題の中心にあるのは、AI研究でも一般的に使われる「蒸留」という手法です。

蒸留とは

- 大型AIモデルの回答を教師データとして

- 小型モデルを学習させる

という技術です。

本来はモデルの軽量化などに使われる正当な方法ですが、他社モデルの回答を大量取得して使う場合、実質的に能力をコピーする行為になると指摘されています。実際に昨年DeepSeekが登場したときにも大きな話題となりました。

米AI企業は、DeepSeekに限らず、中国企業がこうした方法で自社モデルの能力を取り込もうとしていると警戒しています。実際にAnthropicは数万のアカウントが数千万件のクエリを使った大規模な能力抽出の試みを検知したと説明しています。

こうしたアクセスは、

- VPN

- プロキシ

- 自動ツール

などを使い、利用元を隠しながら行われるケースも多いと発表されています。

AI競争は「モデル開発」だけでなく「モデル防衛」へ

今回の連携は、生成AI市場において大きな変化が生じていることを示しています。これまでの競争は

- モデル性能

- GPU

- 学習データ

といった開発能力が中心でした。しかし現在は

- モデルの知的財産

- AI能力の流出

- 国家間のAI競争

といった要素がより強くなっています。

AIは国家安全保障にも関わる技術と見られており、米国政府も中国企業によるAI技術の模倣問題を注視しています。

まとめ

生成AIの蒸留問題は、今後さらに議論が広がっていくでしょう。モデルの回答を使って別モデルを学習させる行為が正当な研究もしくは不当なコピーのどちらに当たるのか、明確な国際ルールはまだ存在していません。

最初にこれらに対して一定の評価をするのは米国である可能性が高いですが、米中抗争に限らず、AI開発競争が単なる技術競争ではなく、知的財産と国家戦略を巡る競争に発展していることを明確に表しています。

日本政府がどのような方針をとるのかもそうですが、それ以上に今後登場していく様々なモデルがどのように作られていくか注目していく必要があるでしょう。