本記事を10秒でまとめると

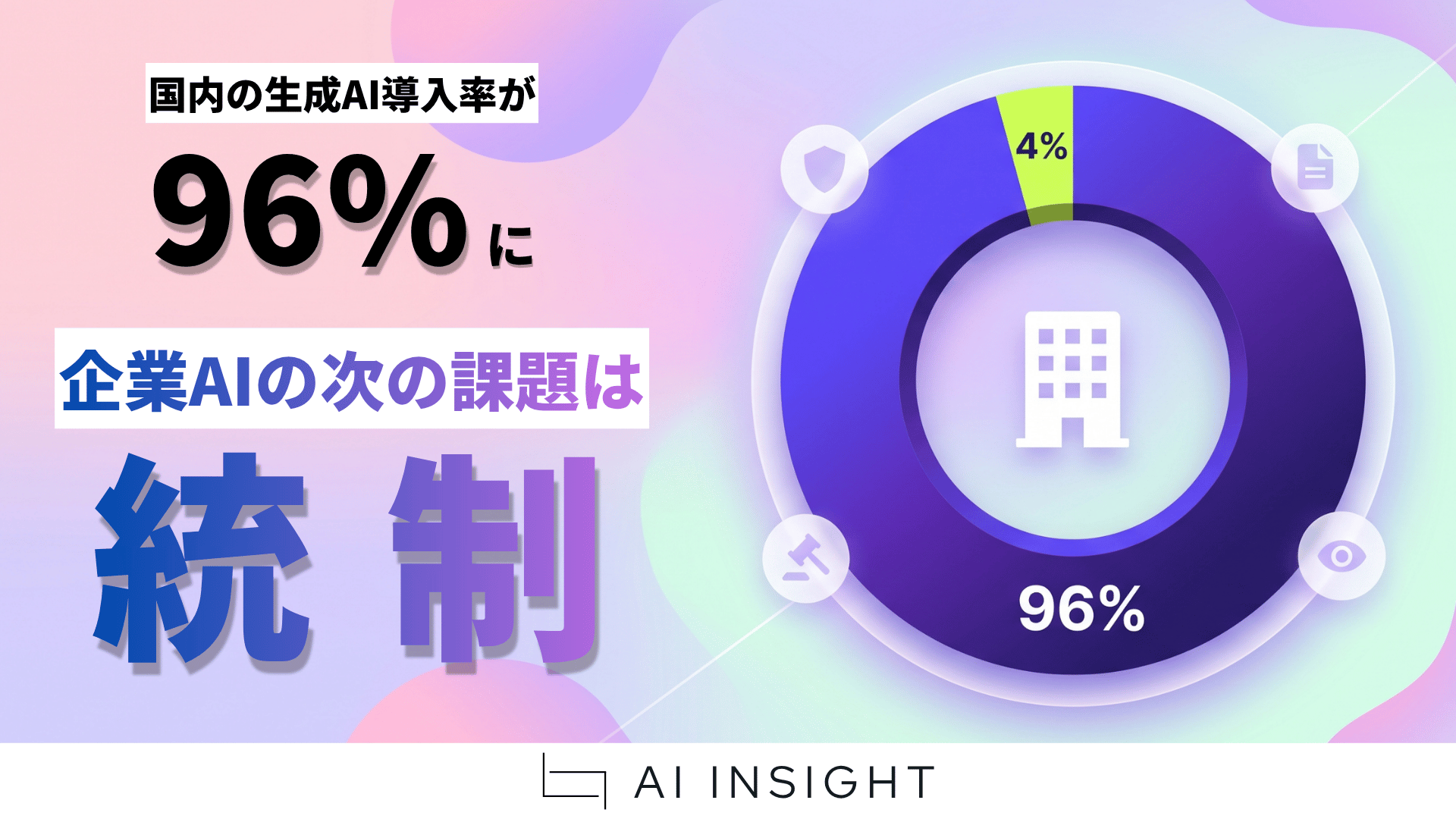

大企業における生成AIの導入率は96%に達し、すでに「実験」ではなく「日常業務のツール」となっている。一方で企業の関心は、導入そのものから「統制(ガバナンス)」へと移りつつある。生成AIのルール整備や法務確認、ベンダー審査など、企業AIを安全に運用するための体制づくりが新たな課題となっている。

生成AI導入率96%、企業利用は当たり前のフェーズへ

NTT東日本とクラスメソッドの合弁企業であるネクストモードは、2026年版の調査レポート「生成AI利用とセキュリティ統制の現在地」を公開しました。

この調査は、従業員1000人以上の企業でDXやセキュリティを担当する150人を対象に、企業の生成AI利用とガバナンスの実態を調べたものとなります。

まず注目すべきは、生成AIの導入率です。調査によると、

- 79.6%の企業が会社として生成AIを導入

- 16.8%は会社導入ではないが社員が利用

となっており、合計すると96.4%の企業で生成AI利用が確認されています。

つまり大企業において生成AIは、もはや試験導入の段階ではなく、日常的な業務ツールとして広く使われるフェーズに入っていると言えます。

企業AIの次のテーマは「統制」

生成AI導入が広がる中で、企業が次に直面する課題は「統制(ガバナンス)」です。調査では、企業がどの程度AI利用の統制体制を整備しているかについても分析されており、

- 76%の企業が生成AI利用の規程を整備

- 70%の企業が未承認AI利用(シャドーAI)を把握する仕組みを導入

- 58.7%の企業がAI利用に伴うリスク評価を実施

といった結果が示されています。つまり多くの企業ではすでに、

- AI利用ルール

- セキュリティ管理

- リスク評価

といったAIガバナンスの基礎整備が進み始めていることが分かります。

最大のリスクは「シャドーAI」

企業AIで特に問題視されているのが、いわゆるシャドーAIです。シャドーAIとは、会社が正式に許可していない生成AIサービスを社員が独自に利用することを指します。

調査では、

- 70%の企業が未承認AI利用を把握する仕組みを導入

- しかし約3割の企業は把握できていない

という結果となっています。

生成AIは個人でも簡単に利用できるため、企業の管理外でAIが利用されるリスクは今後ますます重要な課題になると考えられます。

AIガバナンスは「投資」へ

生成AIの統制は、単なるITルールではなく、企業の投資領域として扱われ始めていることも調査で判明しています。

- 69.3%の企業がAIセキュリティの予算を確保

- 66.7%が法務担当や専門家による法令確認を実施

- 73.3%がAIサービスのベンダー審査を実施

といった結果も調査でしまされました。

企業はAI活用を進める一方で、

- 情報漏洩

- 著作権問題

- 誤情報の拡散

などのリスクを避けるため、組織的な管理体制の整備を進めていることが分かります。

AI任せにしない企業の判断プロセス

もう一つ興味深いのが、人間による最終確認の仕組みです。調査によると、

65.4%の企業が、重要な意思決定にAI出力を使う際に人間の確認を義務付けている。

生成AIの精度が向上しているとはいえ、企業の意思決定を完全にAI任せにすることには慎重な姿勢が見られます。

つまり企業AIは、AIを使うが、最終責任は人間が持つという形で運用されていると言えるでしょう。

まとめ

今回の調査から見えてくるのは、企業AIのフェーズが明確に移行しているという現実です。

これまでの企業AIは導入やPoCなどの導入フェーズが中心でした。

しかし現在は

- AI利用ルール

- セキュリティ管理

- 法務確認

- 社員教育

- ベンダー審査

- 人間による承認

といったAIガバナンスの整備が重要なテーマになっています。

もちろん今回のネクストモードの調査は従業員数1,000名以上の企業での調査ではありますが、生成AIはすでに企業の業務ツールとして普及しており、いまだに生成AIを使うかどうか、何を使うか検討している企業は明確に出遅れてしまっていると言えるでしょう。

これから問われるのは、AIをどう管理し、どう安全に使うかです。そしてそのためには社員のリテラシー教育にどれだけ投資し、効果測定していくか経営レベルで考える必要があるでしょう。

生成AIの活用状況やガバナンス整備がそのまま企業価値に影響を与える時代は今後ますます発展するに違いありません。

参考資料

ネクストモード

「生成AI利用とセキュリティ統制の現在地(2026年版)」

https://prtimes.jp/main/html/rd/p/000000032.000078770.html?utm_source=chatgpt.com