ここ数ヶ月で「ローカルAI」という言葉を目にした人も多いのではないでしょうか。

Ollama、LM Studio、Apple Intelligence、オンデバイスAIなど、生成AIがクラウドではなく自分のデバイス上で動く技術が広がっています。

しかし、ローカルAIの世界はやや複雑です。

- ローカルAIツール

- AIモデル

- 推論エンジン

- オンデバイスAI

など様々な要素が混ざって語られるため、

「結局ローカルAIとは何なのか」が分かりにくくなりがちです。

そこでこの記事では、ローカルAIの構造を

- クラウドAIとの違い

- 技術スタック

- ツールマップ

などの視点から整理します。

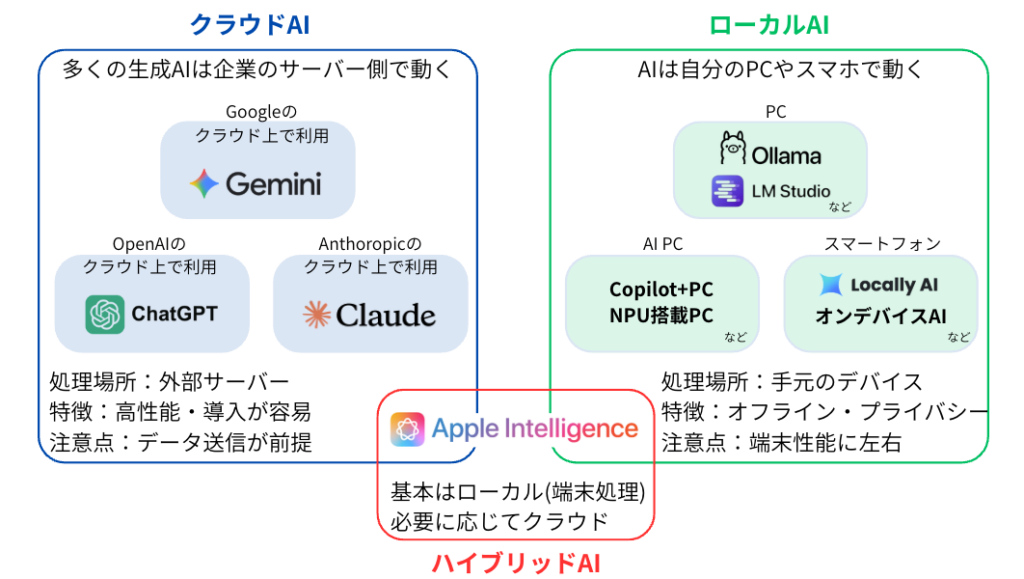

クラウドAI vs ローカルAI

まず基本的な違いから整理します。

クラウドAIは、生成AIモデルが企業のサーバー上で動作するものです。代表例としては

- ChatGPT(OpenAI)

- Claude(Anthropic)

- Gemini(Google)

などがあります。ユーザーはインターネットを通して生成AIにアクセスします。

皆様に撮って一番馴染みが深いのがこれらとなるでしょう。

クラウドAIの特徴は次の通りです。

- 非常に高性能なAIを利用できる

- 導入が簡単

- 常に最新モデルを使える

一方で

- データはクラウドに送信される

- API料金が発生する

- オフラインでは使えない

といった制約があります。

ローカルAI

ローカルAIは、AIモデルが自分のデバイス上で動作する仕組みです。例えば

PCでは

- Ollama

- LM Studio

などのツールを使ってAIを動かします。

スマートフォンでは

- Locally AI

のようなアプリがあります。

ローカルAIの特徴は次の通りです。

- データを外部送信しない

- オフラインでも使える

- API料金が不要

ただし

- モデルサイズが制限される

- デバイス性能に依存する

という制約があります。

ハイブリッドAI

最近増えているのがハイブリッドAIです。代表例は Apple Intelligence。

Apple Intelligenceは

- 基本は端末でAI処理

- 必要な場合のみクラウド

という構造になっています。

Appleは

- Apple Silicon

- MLX

- Apple Intelligence

という形で ハードウェアからAIまで統合したオンデバイスAIを構築しています。

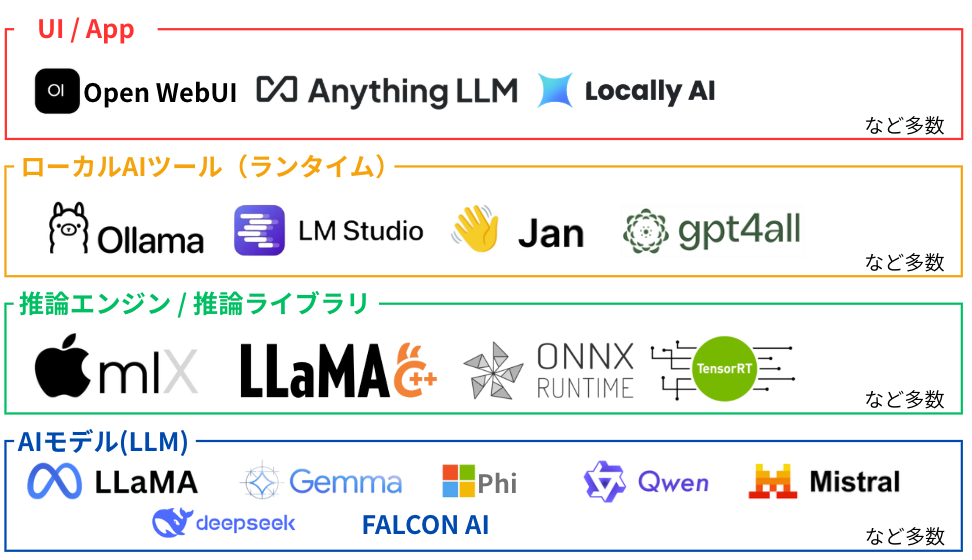

ローカルAIの技術レイヤー

ローカルAIは、単一のツールではありません。実際には複数の技術レイヤーで構成されています。

大きく分けると次の4つです。

- AIモデル

- 推論エンジン

- ローカルAIツール

- UI / アプリ

AIモデル(LLM)

AIモデルは、AIの「頭脳」にあたります。代表的なオープンモデルには次のものがあります。

LLaMA(Meta)

現在のローカルAIの中心的モデル。

多くのローカルAIツールがこのモデルをベースにしています。

Qwen(Alibaba)

近年急速に性能が向上しているモデル。

日本語性能も比較的高いことで知られています。

Gemma(Google)

Googleが公開した軽量モデル。

小型ながら性能が高い点が特徴です。

Mistral(Mistral AI)

欧州発のLLM。

軽量モデルの性能が高く、ローカル環境で人気があります。

Phi(Microsoft)

小型モデルを重視した設計。

比較的少ない計算資源でも動作します。

推論エンジン

AIモデルを実際に動かすソフトウェアが推論エンジンです。代表的なものとしては

llama.cpp

ローカルLLMを動かす軽量エンジン。

多くのローカルAIツールの基盤になっています。

MLX

Apple Silicon向けのAIフレームワーク。

MacやiPhoneでのAI処理を最適化しています。

ONNX Runtime

Microsoft系の推論環境。

多くのAIモデルに対応しています。

TensorRT

NVIDIA GPU向けの高速推論ライブラリです。

ローカルAIツール(ランタイム)

推論エンジンやモデルをまとめて管理するのが ローカルAIツールです。代表的なものは次の通りです。

Ollama

ローカルAIの標準的ツール。

CLIとAPI中心で、開発者向けの環境として広く使われています。

LM Studio

GUIベースのローカルAIツール。

初心者でも簡単にローカルLLMを起動できるのが特徴です。

Jan

デスクトップ型AIクライアント。

ChatGPTのようなUIでローカルAIを使えます。

GPT4All

初期から存在するローカルAIツール。

シンプルな構成で導入しやすいのが特徴です。

UI / アプリ

最上位のレイヤーは、ユーザーが直接触れるアプリです。

Open WebUI

Ollamaなどと連携するブラウザUI。

ChatGPTに近いインターフェースを提供します。

AnythingLLM

RAG(文書検索AI)やエージェント用途に強いツール。

社内ナレッジ検索などで使われることが多いです。

Locally AI

iPhone / iPad / Mac向けのローカルAIアプリ。

モバイルでローカルAIを使える点が特徴です。

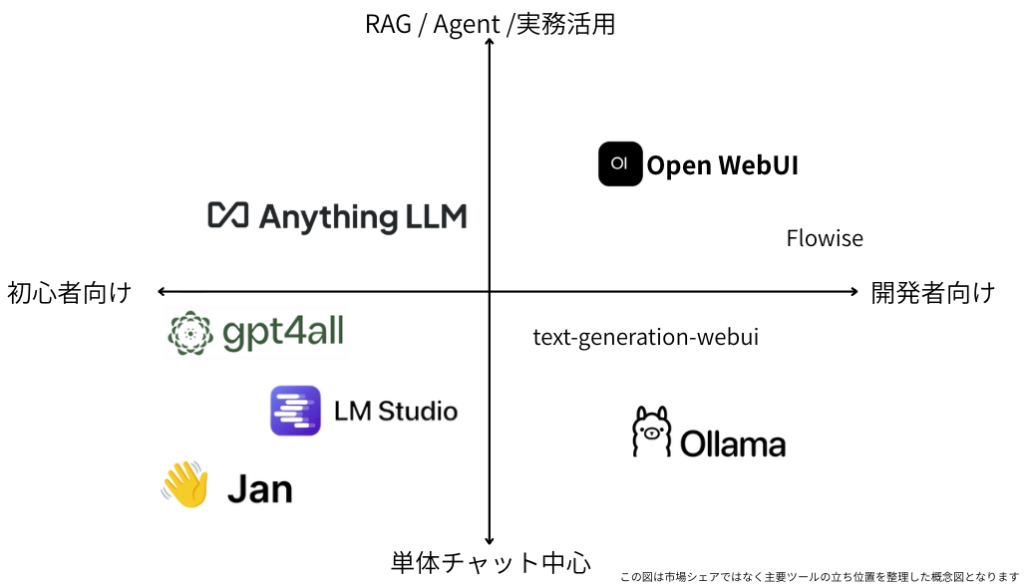

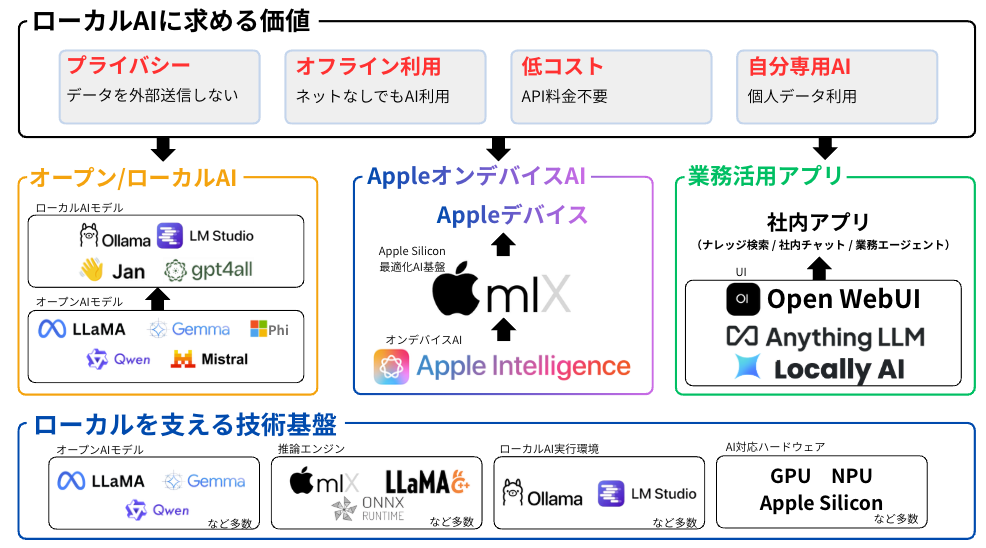

ローカルAIツールマップ

ローカルAIツールは、用途によって立ち位置が異なります。

このマップを見ると、ローカルAIツールの役割は大きく4つの領域に分かれます。

初心者 × 単体チャット

ローカルAIを試してみたいユーザー向けのツールです。代表的なのは

LM Studio

GUIでローカルLLMを起動できるツール。

モデルダウンロードから実行までを簡単に行えるため、

ローカルAIの入門として人気があります。

Jan

ChatGPTに近いUIを持つデスクトップAIクライアント。

ローカルLLMをチャット形式で利用できます。

GPT4All

比較的早い時期から存在するローカルAIツール。

シンプルな構成で導入しやすいのが特徴です。

開発者 × 単体チャット

ローカルLLMを開発環境として利用する領域です。

Ollama

ローカルAI開発環境の事実上の標準ツール。

CLIとAPIを中心とした設計で、

AIアプリ開発の基盤として広く使われています。

text-generation-webui

ローカルLLMを管理するためのUIツール。

複数モデルの管理などに使われることが多い環境です。

初心者 × 実務活用

ローカルAIを業務用途に使うためのツールです。

AnythingLLM

RAG(文書検索AI)機能を備えたツール。

社内ナレッジ検索やドキュメントQAなどに利用されます。

開発者 × 実務活用

ローカルAIを使ってAIアプリを構築する領域です。

Open WebUI

OllamaなどのローカルLLMと接続できる統合UI。

チャット、RAG、エージェントなど幅広い用途に対応します。

Flowise

LLMワークフローを構築するためのツール。

AIエージェントや複雑なAIアプリを作る際に使われます。

総整理:ローカルAIの全体像

ローカルAIは現在、3つの領域で発展しています。

オープン / ローカルAI

OllamaやLM Studioなどを中心としたエコシステムです。この領域の特徴は

- オープンAIモデル

- ローカル実行環境

- 自由なAI開発

です。多くのAI開発者はこの環境をベースにローカルAIアプリを構築しています。

AppleオンデバイスAI

Appleは

- Apple Silicon

- MLX

- Apple Intelligence

を組み合わせた オンデバイスAIエコシステムを構築しています。

ハードウェアとAI基盤を統合している点が他の企業との大きな違いです。

業務活用アプリ

ローカルAIは、単体チャットから業務AI(アプリ)へと広がっています。例えば

- 社内ナレッジ検索

- 業務エージェント

- 社内AIチャット

などです。Open WebUIやAnythingLLMなどはこの領域で使われることが多いツールです。

ローカルAIが注目される理由

ローカルAIが広がっている背景には、次のような価値があります。

- プライバシー

- オフライン利用

- 低コスト

- 自分専用AI

クラウドAIとローカルAIは競合というよりも用途によって使い分ける技術になりつつあります。

今後は

- AI PC

- オンデバイスAI

- エージェント

などと組み合わさり、ローカルAIの活用はさらに広がっていくでしょう。

まとめ

ここまで見てきたように、ローカルAIは単一のツールではなく、複数の技術レイヤーによって構成されています。数年前までローカルAIは「自分のPCでLLMを動かしてみる」という実験的な用途が中心でした。

しかし現在はOllamaの普及に加えて、オープンLLMの進化などによって、ローカルAIの実用性は急上昇しています。

このようにローカルAIの説明をするとよく「ローカルAIはクラウドAIを置き換えるのか」という質問をいただきます。

ですが、実際にはそうならないと予測できます。なぜならば、両者はそれぞれ得意分野が異なり、クラウドAIは

- 大規模モデル

- 高度な推論

- APIエコシステム

に強みがある一方、ローカルAIは

- プライバシー

- オフライン利用

- 自分専用AI

といった用途に向いています。

そのため今後は「クラウドAI+ローカルAI」という形で使い分けられていくと考えられます。

ローカルAIの次の大きなテーマもエージェント化です。

最近はやOpenClawやConwayのように、生成AIがコードを書いたりタスクを自律的に実行するエージェントの研究も進んでいます。

現時点では多くがクラウドAIベースですが、(厳密には使うLLM次第)今後は

- ローカルLLM

- RAG

- エージェント

を組み合わせたローカルAIエージェントも増えていくと予測されます。

生成AIの世界ではこれまで「クラウドAI」が中心でした。しかし生成AIは徐々にユーザーのデバイス側にも広がっています。

その意味で我々はローカルAIを生成AIのもう一つの基盤と捉え、選択・判断する姿勢が求められていくでしょう。

writer:宮﨑 佑太(AI経営コンサルタント)