本記事を10秒でまとめると

LM Studioはモバイル向けローカルAIアプリ「Locally AI」の買収を発表。Locally AIはiPhone、iPad、Mac上でAIモデルをローカル実行できるアプリであり、今回の買収によりLM StudioはPCだけでなくモバイルを含むデバイス横断のローカルAI体験を強化する方針を示した。

LM StudioがLocally AIを買収

2026年4月8日、ローカルAIツール「LM Studio」を開発するElement Labsは、モバイル向けローカルAIアプリ「Locally AI」を買収したと公式ブログで発表しました。

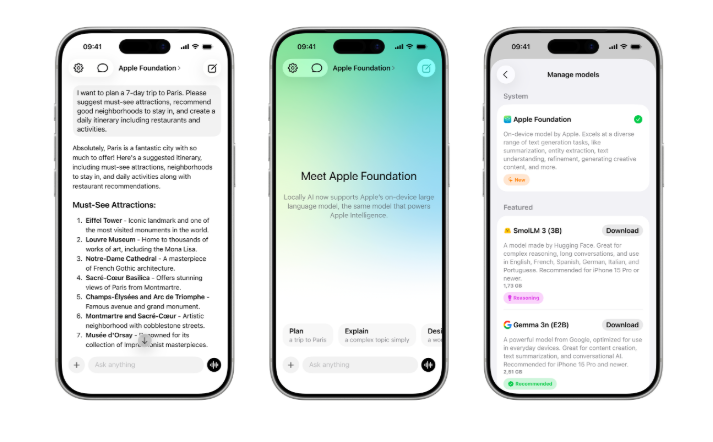

Locally AIは開発者Adrien Grondin氏が手がけるアプリで、iPhone、iPad、Mac上でAIモデルをローカル実行できることが特徴となっています。買収後、Grondin氏はLM Studioチームに参加し、今後は「デバイス全体にまたがるネイティブAI体験」の開発を主導することも発表されました。

LM Studioは今回の発表の中で、ユーザー自身のデバイス上でAIモデルやAIエージェントをシームレスに利用できる環境の構築を目指すと説明しています。

Locally AIとは何か

Locally AIは、AIモデルをクラウドではなくユーザーのデバイス上で直接実行するアプリです。

ChatGPTやGeminiなど多くのAIサービスはクラウド上で動作しますが、ローカルAIではモデルをスマートフォンやPCにダウンロードして実行するため、以下のような特徴があります。

- データを外部サーバーに送信しない

- オフラインでもAIを利用できる

- 個人データを安全に扱いやすい

こうした特徴から、ローカルAIはプライバシー重視の生成AI利用として注目を集めています。

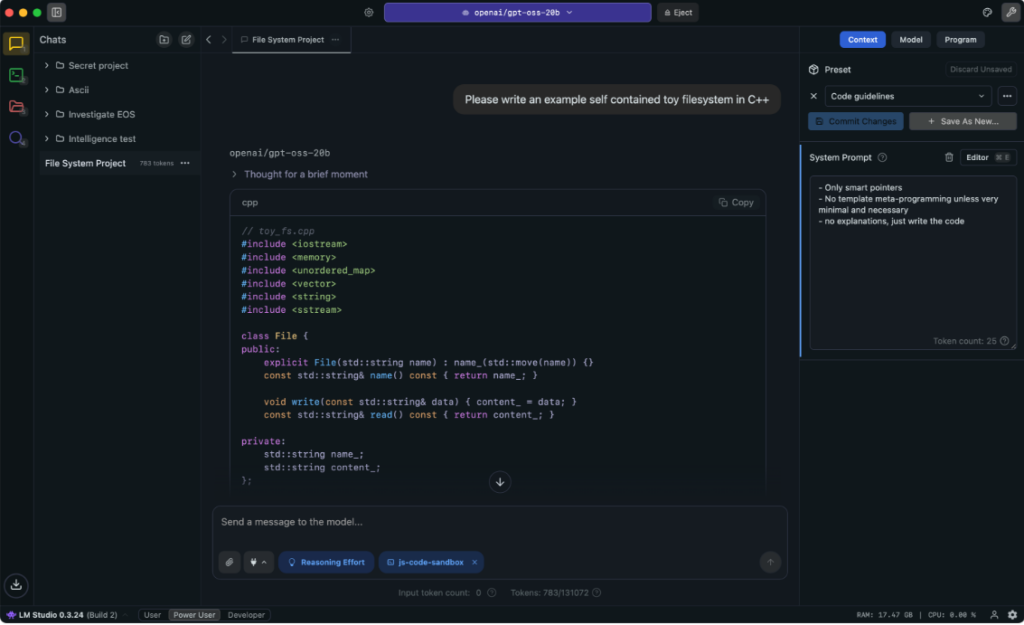

LM Studioとは

LM Studioは、PC上でAIモデルを簡単に実行できるローカルAIツールです。

LlamaやMistralなどのオープンAIモデルをダウンロードし、GUI環境で管理・実行できる点が特徴で、ローカルAIを扱うための代表的なツールの一つとなっています。

今回の買収により、LM StudioはPCだけでなくスマートフォンやタブレットを含むモバイル環境でもローカルAI体験を拡張していくことになるでしょう。

まとめ

近年、生成AIの多くはクラウド型として提供されていますが、一方でデバイス上でAIを実行する「ローカルAI」への関心も高まってきています。

その背景は主に以下となります。

- プライバシー保護の重要性

- AI PCやオンデバイスAIの普及

- モバイル端末の性能向上

ローカルAIについての詳細は以下の記事をご覧ください。

ローカルAIは現在も急速に進化しており、生成AIの利用形態がクラウド中心からデバイス中心へ広がる未来もそう遠くないかもしれません。

writer:佐伯 美月(AIインサイト編集部)