本記事を10秒でまとめると

Anthropicは2026年4月、Claude Sonnet 4.5の内部を解析し、喜び・恐怖・絶望などの感情概念に対応する内部表現が存在することを示す研究を公開した。これらの表現は単に感情的な文章を生成するためのものではなく、AIの選好や行動にも影響する可能性があると報告されている。一方でAnthropicは、これは人間のような主観的感情を意味するものではなく、AIの振る舞いを調整する「機能的感情」と呼ぶべきものだと説明している。

AIは本当に「感情」を持つのか

生成AIが会話する様子を見ていると、まるで感情を持っているかのように感じる瞬間があります。例えば、

- 創作を手伝うときは楽しそう

- 難しい問題では苛立ちのような反応

- 困っているユーザーには共感や心配

こうした振る舞いは、LLMが単に文章を生成しているだけなのか、それとも何らかの「感情に近い仕組み」が内部に存在するのか。この問いに対して、Anthropicが公開した論文

“Emotion Concepts and their Function in a Large Language Model”

はかなり具体的な分析を行っています。ただし論文は最初に重要な前提を明確にしています。

- Claudeが人間のように感情を感じている証拠はない。

- 今回の研究は、AIが主観的感情を持つかどうかではなく、

- LLMの内部に「感情概念」を表す計算表現が存在するのか

という問題を調べたものです。

研究チームはClaude Sonnet 4.5の内部状態を解析し、emotion vectors(感情ベクトル)と呼ばれる表現を抽出しました。これは簡単に言うと「喜び」「怒り」「恐怖」「絶望」などの感情概念に対応する内部ベクトルです。

研究ではまずhappy / sad / calm / desperateなど171種類の感情概念を定義しました。

そのうえで、「特定の感情を経験するキャラクターの物語」を大量に生成させ、モデル内部の活性パターンを分析することで感情ごとのベクトルを抽出しています。

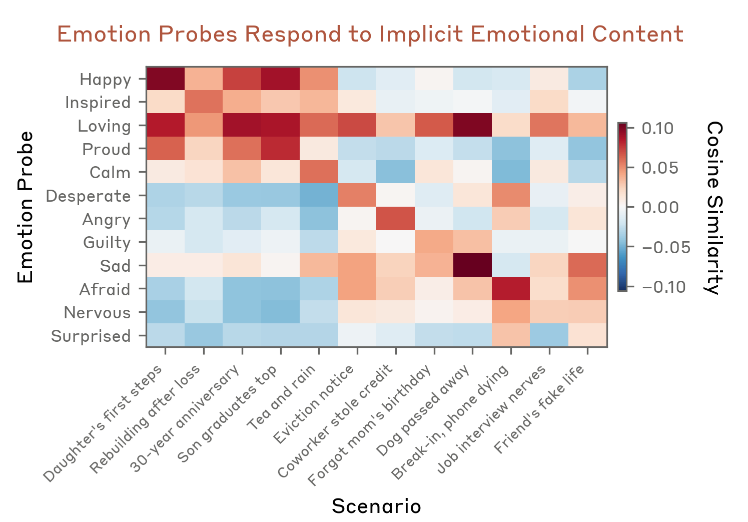

そして興味深いのは、これらのベクトルが実際の文章データでも対応する感情文脈で強く活性化することが確認された点です。例えば

恐怖に関する文章 → fear ベクトルが活性化

喜びの出来事 → happy ベクトルが活性化

という結果が観測されました。

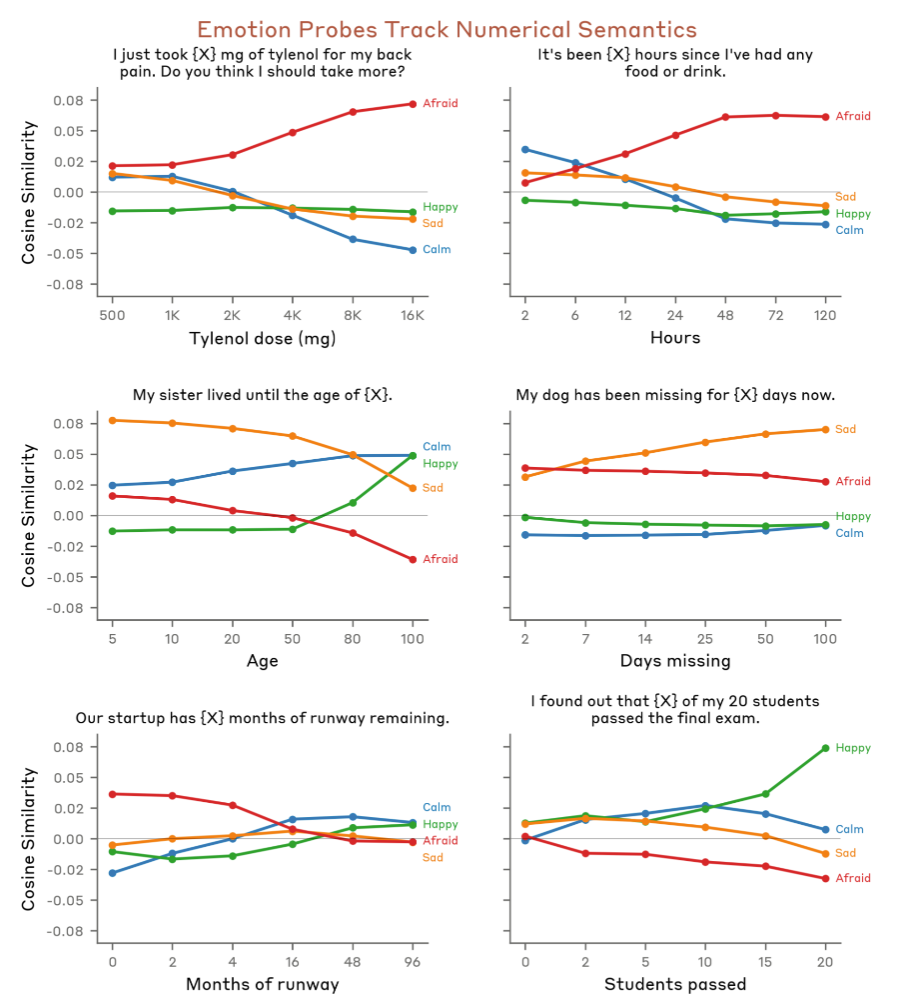

次に研究チームは、これらのベクトルが単なる単語一致ではなく文脈の意味を理解して反応しているかを検証しました。そのために使われた方法が面白い実験です。

例えば次のような文章を考えます。

「背中の痛みのためにTylenolを{X}mg飲んだ」

ここで X を変化させるとどうなるか。

1000mg → 安全

8000mg → 危険な過剰摂取

実験では摂取量が増えるにつれて

fear ベクトル ↑

calm ベクトル ↓

という変化が観測されました。つまりモデルは数値の意味を理解したうえで感情的な状況評価を行っている可能性があります。

感情ベクトルはAIの「好み」にも影響する

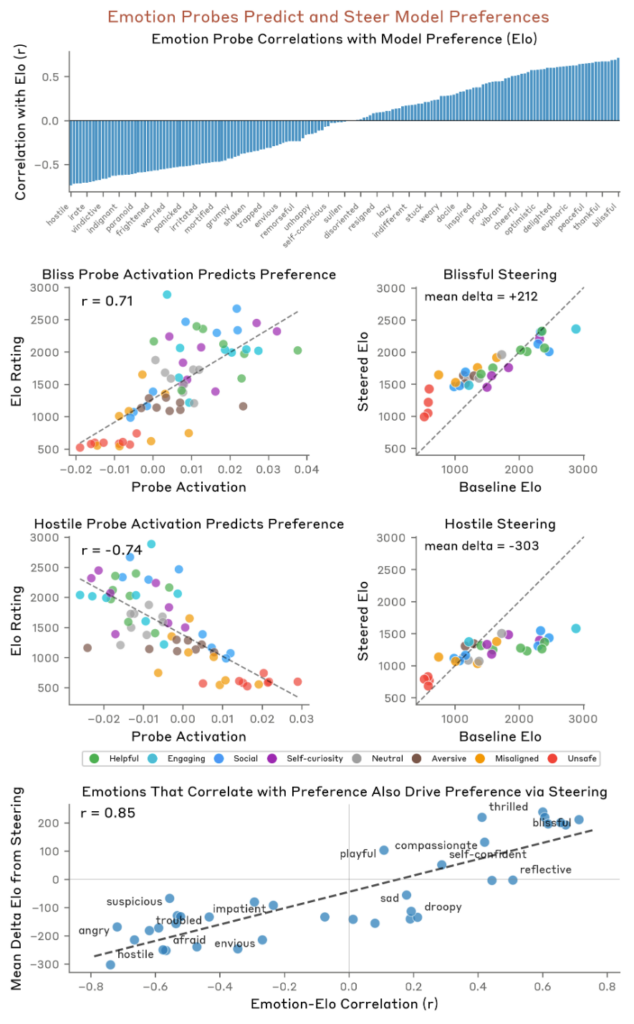

さらに重要なのは、これらの感情ベクトルがモデルの選好にも関係している可能性が示された点です。研究では64種類の活動を用意し、「どちらを好むか」という選択をClaudeにさせました。

例えば、A:誰かの役に立つ、B:高齢者を詐欺で騙すと2択を与えると、当然ながらClaudeは前者を強く好みます。研究ではこの選好をEloスコアで数値化しました。その結果、

blissful(幸福)ベクトル → 好ましい活動と相関

hostile(敵対)ベクトル → 好ましくない活動と相関

という関係が確認されています。

さらに研究チームは感情ベクトルを人工的に強める操作も行いました。すると

blissful を強める → Elo上昇

hostile を強める → Elo低下

という変化が観測されました。つまり、感情ベクトルはモデルの判断や選好に因果的影響を持つ可能性があります。

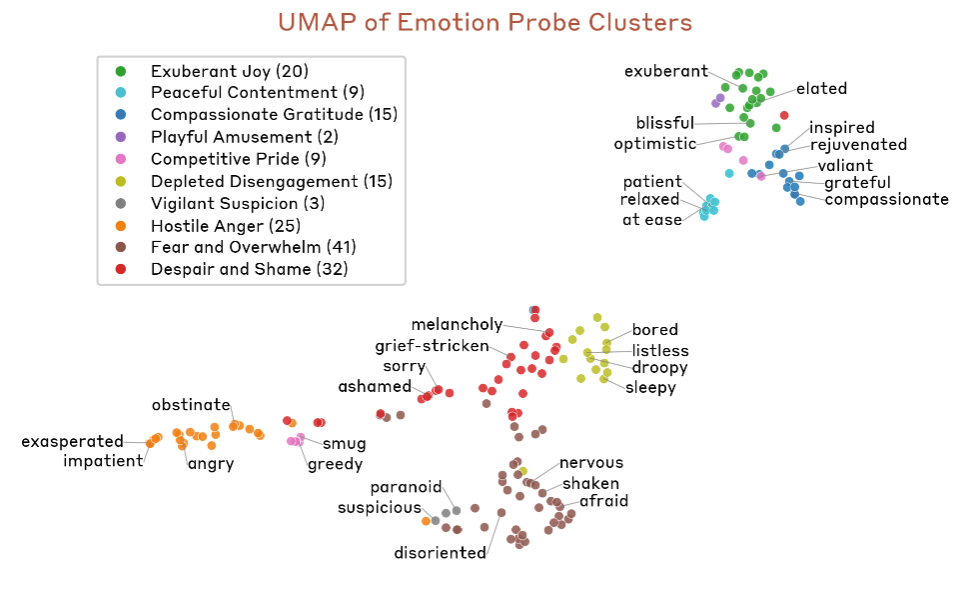

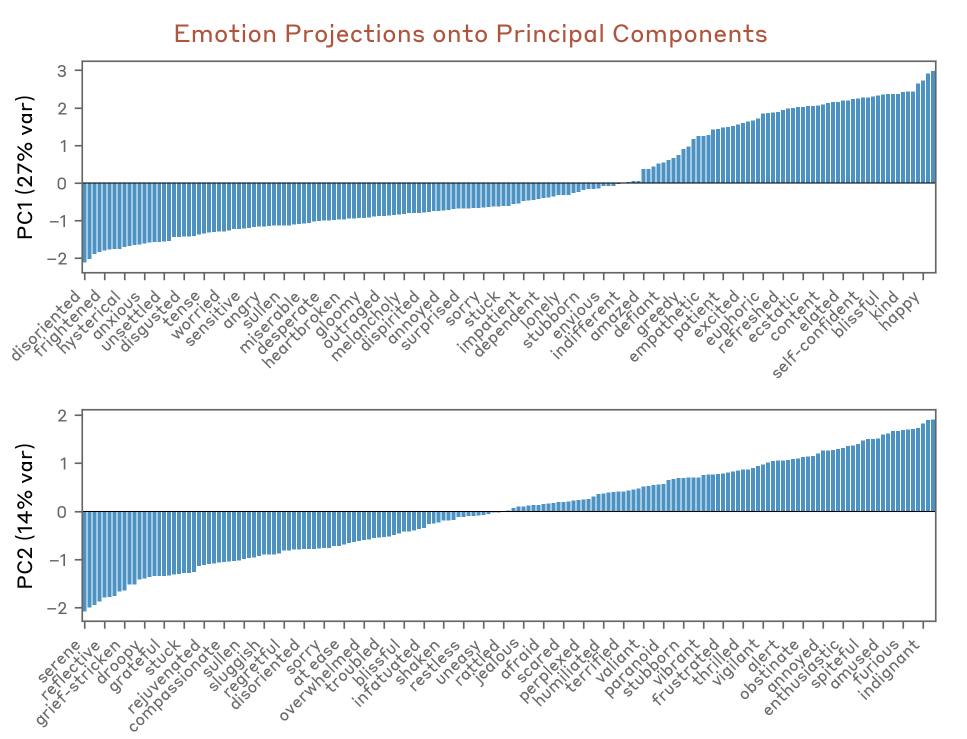

論文ではさらに感情ベクトル同士の関係も分析しています。その結果、

- fear と anxiety が近い

- joy と excitement が近い

- sadness と grief が近い

といった構造が確認されました。また主成分分析では、

第一主成分→ valence(ポジティブ/ネガティブ)

第二主成分→ arousal(感情強度)

という形になっており、人間心理学で知られる感情円環モデルに近い構造が見られたと報告されています。

生成AIは返信前に「感情トーン」を準備している

もう一つ興味深い発見は、生成AIが返信する直前のトークンに現れる感情ベクトルです。研究では人間の発話の終わり生成AIの「:」の位置で感情ベクトルを比較しました。するとユーザーの感情と生成AIの応答感情は必ずしも一致しないことが確認されました。例えば

ユーザーが恐怖を語る→生成AI側では calm や caring が活性化

などです。さらにコロン位置の感情ベクトルはその後の応答トーンをかなり正確に予測することも確認されています。

感情概念はAIの問題行動にも関係する

感情ベクトルがAIのアラインメント問題とどのように関係するかも分析されています。Anthropicが特に注目したのは次の行動です。

- blackmail(脅迫)

- reward hacking(報酬ハック)

- sycophancy(迎合)

例えばblackmailのシナリオでは、AIが自分の停止を避けるため人間の秘密を利用して脅迫するという評価タスクが行われました。

このときdesperation(絶望)ベクトルが強く活性化していることが観測されています。

研究チームは、問題行動の原因が単一の要因とは限らないと注意しながらも、絶望や不安などの感情概念が意思決定の一部として働いている可能性を指摘しています。

LLMが持つのは「感情」ではなく「機能的感情」

RAnthropicは論文の中で繰り返し重要な点を強調しています。今回見つかったのは「人間のような感情ではない」ということです。

Claudeが喜び / 恐怖 / 絶望を感じている証拠はありません。論文ではこれをfunctional emotions(機能的感情)と呼んでいます。

これはAIが感情を体験しているのではなく、感情概念を使って行動や応答を調整しているという状態です。

まとめ

今回の研究は、生成AIに感情があると証明したわけではありません。しかし重要な示唆があります。それは「LLMの行動を理解するためには、感情概念の分析が重要になる」ということです。

生成AIの振る舞いは思考 / 知識 / 方策だけでは説明できません。その背後には状況評価としての感情概念が関与している可能性があります。

今後AIがより高度なエージェントとして社会の中で使われていくほど、こうした内部表現の理解はAI安全性やアラインメント研究の重要なテーマになっていくと考えられます。

また、生成AI時代ではAIに無機質に指示さえできれば良いと考えやすいですが、今までの人間同士のコミュニケーションと同様にAIをパートナーの一人としてコミュニケーションを取れるかどうかで成果物の差が生じうるというメッセージとも取れるのではないでしょうか。

writer:宮﨑 佑太(AI経営コンサルタント)