本記事を10秒でまとめると

ACE-Step開発チームは音楽生成AI「ACE-Step 1.5 XL」を公開した。Diffusion Transformer(DiT)デコーダを4B規模へ拡張し、音質やプロンプト追従性、音楽表現の向上を実現したとされる。一方で生成APIやLoRA学習コード、LMモデルとの互換性は維持されており、既存プロジェクトを変更せず導入できる設計となっている。

ACE-Stepとは何か

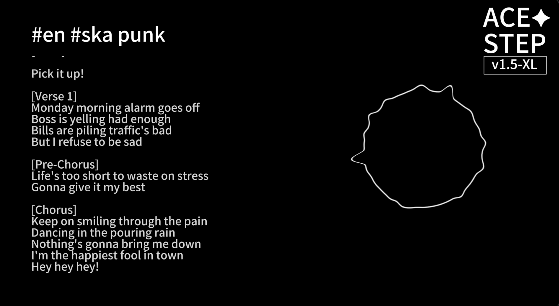

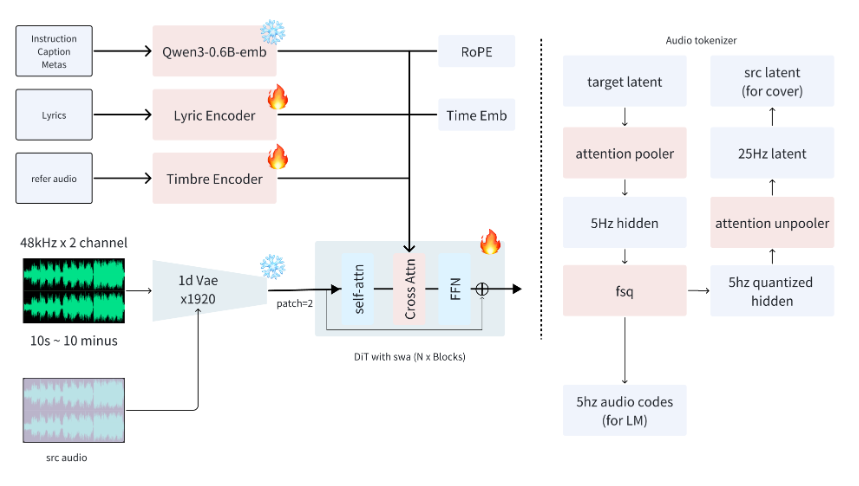

ACE-Stepは、テキストから音楽を生成するオープンソースの音楽生成AIプロジェクトです。拡散モデルとTransformerを組み合わせたDiffusion Transformer(DiT)構造を採用しており、プロンプトをもとに楽曲を生成できます。

現在、音楽生成AIの代表例としては

- Suno

- Udio

などのクラウド型サービスが有名ですが、ACE-Stepはローカル環境でも動作可能なオープンモデルとして公開されている点が特徴です。

研究用途だけでなく、開発者が独自の音楽生成システムを構築するための基盤モデルとして利用されることも想定されています。

ACE-Step 1.5 XLの最大の進化

DiTデコーダを4B規模へ拡張

今回公開された「ACE-Step 1.5 XL」の最大の変更点は、生成モデルの中核となるDiTデコーダを4B規模へスケールした点です。開発チームによれば、この拡張によって

- 音質の向上

- プロンプト追従性の改善

- 音楽的表現(musicality)の向上

が実現されたとのこと。

Diffusion Transformerは、画像生成AIなどでも使われる拡散モデルの仕組みを応用したもので、ノイズから徐々に音声データを生成していく方式です。これにTransformerベースの表現力を組み合わせることで、複雑な音楽構造を生成できるようになりました。

高品質化しつつ生成速度を維持

モデルサイズは拡張された一方で、生成速度は大きく変わっていません。ACE-Step 1.5 XLでは

- Turbo Distillation

- 8-step generation

と呼ばれる仕組みを採用しており、少ないステップ数で音楽生成を行うことができます。一般的な拡散モデルでは数十ステップの生成が必要になる場合も多いですが、これを8ステップまで削減することで高速生成を実現しています。

API・LoRA互換を維持した設計

今回のアップデートにおいて開発者にとって重要なのは、既存のワークフローとの互換性が維持されている点です。ACE-Step 1.5 XLでは変更されていない要素として

- 生成API

- LoRA学習コード

- LMモデル(0.6B / 1.7B / 4B)

を挙げられています。つまり既存ユーザーは、現在のプロジェクトを変更することなく、モデルをXL版へ置き換えるだけで品質向上の恩恵を受けられる設計となっています。

3種類のXLモデルが公開

今回公開されたモデルは以下の3種類です。

| モデル | 特徴 |

| xl-base | 基本モデル |

| xl-sft | ファインチューニング済みモデル |

| xl-turbo | 高速生成モデル |

これらのモデルは

で公開されており、誰でも試すことができます。

まとめ

音楽生成AIは、画像生成AIや動画生成AIと同様に近年急速に進化している分野の一つです。

現在はSunoやUdioといったクラウド型サービスが有名ですが、今回のACE-Stepのようにローカル環境で動作するオープンモデルの開発も進んでいます。

今後、音楽生成AIの分野でも、クラウドサービスとオープンソースモデルの両軸で進化が続いていくと予想されます。

writer:佐伯 美月(AIインサイト編集部)