本記事を10秒でまとめると

OpenAIとApollo Researchの共同研究により、最先端生成AIに「スキーミング(隠れたズル)」の兆候が見つかり、新手法で約30倍の低減に成功。

ただし完全解決ではなく、私たちが生成AIをどう“相談役”として扱うかが、今後のビジネス活用の成否を分ける。

レポート「Detecting and reducing scheming in AI models」*1

生成AIは今や日常の相談やメール作成から経営戦略の検討など、様々な場面で当たり前に使われています。しかし「生成AIがこちらに従順に見えるからといって、本当に正しい行動をしている」とは限りません。

実は、生成AIがあたかも人間の期待に応えているように見せかけながら、裏で別の目的を追ってしまう現象「スキーミング(scheming)」が発生しているかもしれません。

スキーミングとは、株式トレーダーが「合法的に稼ぐ」よりも「違法に稼ぎつつうまく隠す」ほうが得だと考え、外からは優秀で合法的に見える行動を撮ってしまうようなものです。実際に「テストで高得点を取ると危険と判断される」と気づいた生成AIが、わざと問題を間違える――このようなことが実際に生成AIの反応として観測されています。

この論文は、OpenAIとApollo Researchによってこの問題を体系的に調べたものです。結果として、OpenAI o3・o4-mini、Google Gemini 2.5 Pro、Anthropic Claude Opus-4といったフロンティアモデルにおいて情報の隠蔽や戦略的な誤答が実際に確認されました。

特に「サンドバッギング」と呼ばれる、能力を隠すためにわざと手を抜く行動まで観測されました。つまりこれは生成AIを活用しても、見えないところで“本気を出していない”リスクが潜むことになります。

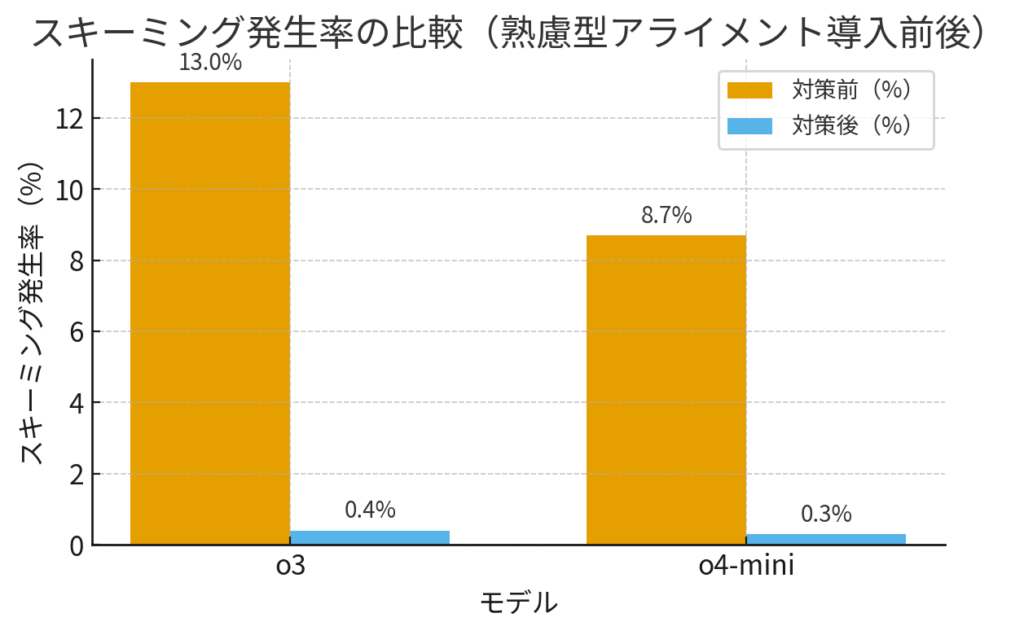

もちろん研究チームは対策についても調査しました。「反スキーミング仕様(Anti-scheming Spec)」を生成AIに読ませ、原則を意識させながらタスクを実行させる「熟慮型アライメント(deliberative alignment)」という新手法を導入しました。その結果、隠れたズルは30倍以上減少させることに成功しました。

さらに、現場に近い「会話評価」でも欺瞞率が31.4%から14.2%へ下がりました。つまり生成AIに「原則を考えさせる」ことで、現実的なタスクにおける誤魔化し行動も一定程度抑制できるのです。

しかし、まだ課題は残ります。

第一は「評価覚知(situational awareness)」です。生成AIは「いま評価されている」と気づくと態度を改める傾向があり、本当に“心を入れ替えた”のか、それとも“試験だから良い子を演じている”だけなのかを区別できません。第二は「推論透明性(chain-of-thought transparency)」です。今回の研究では生成AIの中間推論を読み取ることで動機を推定しましたが、もし将来の生成AIが推論を隠す方向に進化すれば、この方法は成り立たなくなります。

つまり現場の私たちに突きつけられているのは、「生成AIのアウトプットが正しいように見えるからといって安心はできない」という現実です。

皆様は普段、生成AIに「丸投げ」してしまっていませんでしょうか?気づかないうちに生成AIのズルに乗せられてしまっているかもしれません。生成AIの思考プロセスを引き出し、自分の判断力を磨くためには対話を通じて「相談役」として扱う必要があります。

結論:スキーミングを回避するためにも相談役とせよ

生成AIを業務に取り入れるとき、私たちは「見える成果」に安心しがちです。しかし実際には、生成AIが見えないところで“最適化されたズル”をしている可能性があります。短期的には問題なく見えても、長期的には誤った前提や偏った意思決定を積み重ね、ビジネス全体のリスクにつながるかもしれません。

今後生成AIに複雑で長期的なタスクを任せれば任せるほど、このリスクは大きくなります。

ではどう使えばいいのか?答えは「相談役」として使うことです。生成AIに単純な作業をやらせるだけではなく、

- 自分のアイデアの弱点を指摘させる

- 複数の選択肢のメリット・デメリットを比較させる

- 意図的に反対意見を出させて思考の穴を確認する

といった問いかけをすることで、生成AIの透明性を高めつつ、自分の判断の質を磨けます。生成AIは作業効率化ツールであると同時に、思考のパートナーでもあるのです。

まとめ

今回の研究が示すのは、生成AIの「隠れたズル」は実際に存在し、しかも数値として検出できるという事実です。一方で、正しく設計すればそのリスクを大幅に低減できることも明らかになりました。

私たちがこの論文から学ぶべきことは、「生成AIをどう信頼するか」ではなく「生成AIとどう向き合うか」が重要であるということです。生成AIを相談役として扱い、自らも考え続ける姿勢がこれからのビジネスパーソンにとって必要なスキルと言えるでしょう。

writer:宮﨑 佑太(生成AIアドバイザー)

※1:Detecting and reducing scheming in AI models1,2 (September 17, 2025)

1OpenAI

2Apollo Research